随着人工智能技术的快速发展和广泛应用,其治理问题已成为全球关注的焦点。有效的AI治理需要系统性地回应三个基本问题:理解其底层技术逻辑,识别并应对潜在风险挑战,并在此基础上制定科学的公共政策,其中公共数据的治理尤为关键。

一、技术逻辑:人工智能的运行基础与公共数据

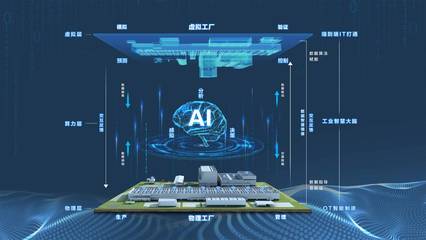

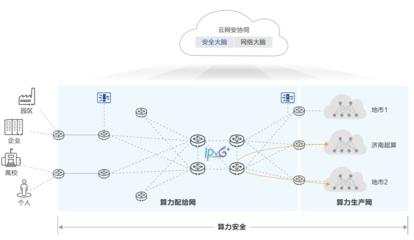

人工智能的技术逻辑根植于算法、算力和数据三大支柱。算法是AI的“大脑”,决定了其学习和决策的方式;算力提供了必要的计算资源;而数据,尤其是公共数据,则是AI模型训练和优化的“燃料”。公共数据因其规模大、覆盖广、代表性强的特点,在推动AI技术创新和应用落地方面发挥着不可替代的作用。公共数据的收集、使用与管理也涉及隐私保护、数据质量、公平性等一系列复杂的技术与伦理问题,构成了AI技术逻辑中必须审慎处理的核心环节。

二、风险挑战:从技术缺陷到社会冲击

人工智能在带来巨大效益的也伴随着多维度的风险挑战,这些风险大多与公共数据密切相关。

1. 技术性风险:包括算法偏见与歧视(源于训练数据的不平衡或带有社会偏见)、系统安全漏洞、不可解释的“黑箱”决策等。当公共数据本身存在偏差时,训练出的AI系统可能放大社会不公。

2. 社会性风险:涉及大规模失业(职业替代)、隐私侵蚀(通过数据聚合与分析)、数字鸿沟加剧以及可能被用于恶意监控或舆论操纵。公共数据的滥用可能严重侵害公民权利。

3. 伦理与法律风险:如责任归属困境(自动驾驶事故责任)、自主武器系统的道德风险,以及现有法律体系在应对AI生成内容版权、AI主体资格等问题上的滞后。

这些挑战表明,AI治理不能仅停留在技术层面,必须进行跨学科、全社会的风险评估与应对。

三、公共政策选择:构建敏捷、包容、负责任的治理框架

面对AI的技术逻辑与风险挑战,公共政策的选择需要平衡创新激励与风险规制,其核心目标应是促进可信赖人工智能的发展。关键政策方向包括:

- 完善数据治理体系:制定清晰的公共数据开放与共享规则,在保障国家安全、商业秘密和个人隐私的前提下,促进数据要素的高效、合规流通。建立数据质量标准和审计机制,从源头减少偏见。

- 强化算法监管与问责:推行算法影响评估和透明度要求,对高风险AI系统(如用于招聘、信贷、司法)实施更严格的测试、认证和持续监控。建立明确的AI事故责任认定与追溯机制。

- 推动多方协同共治:构建政府、企业、学术界、公民社会共同参与的治理生态。政府负责设定底线规则与标准;企业需履行主体责任,践行伦理设计;学术界提供技术洞察与伦理研究;公众则应参与监督和评议。

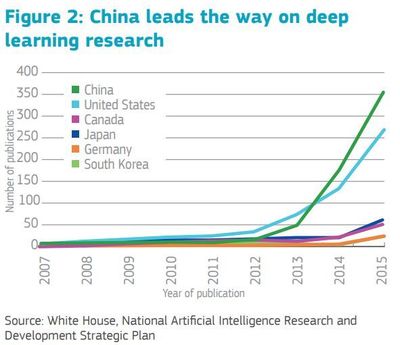

- 加强能力建设与国际合作:投资于AI素养教育,提升公众认知与技能;积极参与全球AI治理规则对话,在数据跨境流动、伦理准则、安全标准等方面寻求国际合作,共同应对跨国挑战。

人工智能的治理是一个动态演进的过程,其核心在于妥善处理技术潜力、风险管控与公共利益之间的关系。深刻理解AI的技术逻辑(尤其是公共数据的基础作用),全面评估其伴生的风险挑战,并在此基础上做出审慎、灵活且富有远见的公共政策选择,是引导人工智能向善发展、造福全人类的关键所在。未来的治理框架必须是技术敏锐的、风险感知的,并且始终以人为中心。